01Introducción

La inteligencia artificial (IA), en particular el aprendizaje automático (ML), proporciona importantes capacidades inteligentes para la micro{0}}nanofabricación láser, demostrando un rendimiento excepcional en áreas como el modelado de procesos de fabricación, la optimización de parámetros de procesos y la detección de anomalías en tiempo real-. Este potencial transformador está impulsando el desarrollo de la próxima generación de tecnologías de micro-nanofabricación láser. Los principales desafíos que enfrenta la fabricación láser tradicional surgen de la complejidad de las interacciones entre el láser y el material, que conducen a resultados de procesamiento incontrolables y a la acumulación de micro-nanodefectos durante procesos de múltiples-pasos, lo que en última instancia resulta en fallas catastróficas en el proceso. La combinación de IA con tecnologías de fabricación láser, mediante la integración de modelado basado en datos-y modelado basado en física-, así como tecnologías inteligentes de control adaptativo y monitoreo in situ, puede abordar estos desafíos de manera efectiva. ¿Qué cambios revolucionarios se producirán cuando la IA "se encuentre" con la fabricación por láser?

02Aprendizaje automático-Inteligencia asistida

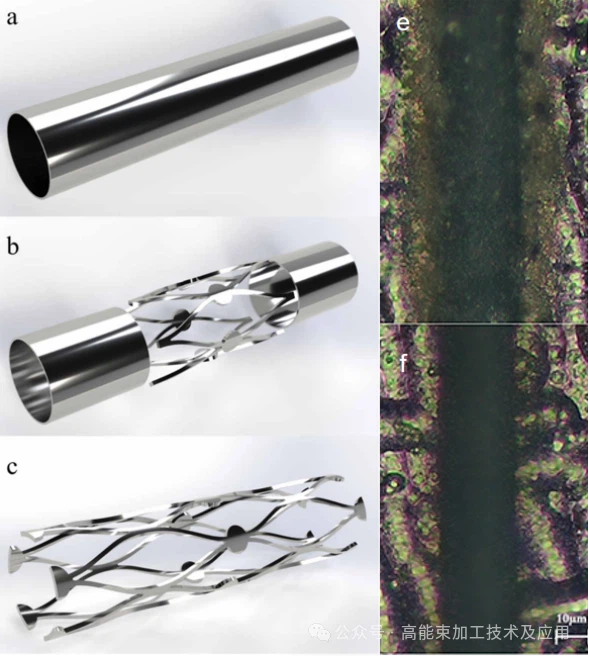

Procesamiento láser En el procesamiento láser convencional, los procesos físicos de las interacciones del láser-material implican efectos termodinámicos no lineales complejos, comportamientos de dinámica de fluidos y transiciones de fase, lo que hace que los mecanismos inherentes sean muy complicados y estén influenciados por numerosos parámetros del proceso, como la potencia del láser y la velocidad de escaneo. Aunque los modelos analíticos-basados en la física o las simulaciones numéricas tienen un significado claro, se enfrentan a importantes desafíos a la hora de caracterizar con precisión fenómenos transitorios, de múltiples-escalas y de múltiples-físicas durante el procesamiento práctico. La principal ventaja del modelado asistido por aprendizaje automático- reside en su capacidad para aprender relaciones no lineales complejas a partir de datos, capturando de manera efectiva las correlaciones cartográficas entre los parámetros del proceso, los estados del proceso y los indicadores de calidad final, "evitando así" el análisis complejo de modelos físicos para lograr la predicción, la optimización y el control de los resultados del procesamiento. El modelado de procesamiento láser asistido por aprendizaje automático-se divide principalmente en dos tipos: modelado-basado en datos y modelado-basado en física. En comparación con el modelado-basado en datos, que explora "modelos de caja negra" entre entradas y salidas a través de datos experimentales, el modelado-basado en la física incorpora leyes físicas como restricciones suaves (términos de función de pérdida) o restricciones estrictas (arquitectura de red). El modelado basado en la física-no solo utiliza datos de observación, sino que también integra completamente conocimientos previos que describen procesos físicos fundamentales. Modelado-impulsado por datos: las interfaces cerebrales-computadoras (BCI) establecen vías de comunicación entre el cerebro humano y los dispositivos externos evitando las rutas de neurotransmisión biológica a través de sistemas de adquisición y decodificación de señales neuronales. Actualmente, una técnica de intervención neuronal relativamente avanzada emplea sistemas de electrodos mínimamente invasivos desplegados dentro de la vasculatura cerebral. Los stents de nitinol sirven como portadores de electrodos intravasculares para recoger señales electroencefalográficas o administrar estimulación eléctrica. Los métodos de ensamblaje tradicionales utilizan principalmente adhesivos curables por ultravioleta-para fijar electrodos de platino a la superficie del stent combinados con conexiones de micro-soldadura. El mecanismo de "procesamiento en frío" de los láseres ultrarrápidos mantiene la integridad de la interfaz neurovascular sin causar daño térmico. Utilizando XGBoost (eXtreme Gradient Boosting) y SVM (Support Vector Machine), se pueden hacer predicciones para el ancho de la incisión y la frecuencia de repetición. La verificación experimental mostró que la energía de un solo-pulso se redujo de 20 μJ no optimizados a 7,64 μJ, la frecuencia de repetición aumentó de 40 kHz a 52,28 kHz y la velocidad de escaneo disminuyó de 20 mm/s a 8,33 mm/s. Los resultados del procesamiento se muestran en la Figura 1. La Figura 1e muestra la morfología de la microestructura no optimizada, mientras que la Figura 1f muestra la morfología de procesamiento optimizada, lo que indica claramente que la estructura optimizada tiene una zona afectada por el calor más pequeña y una mayor precisión de procesamiento.

Modelado de mecanismos físicos:

En comparación con el alto costo y el largo ciclo del modelado-basado en datos, el modelado de mecanismos físicos evita la necesidad de conjuntos de datos pre-calculados al incorporar ecuaciones diferenciales parciales en la función de pérdida de una red neuronal. El micromecanizado-de plasma inducido por láser-(LIPMM) está restringido por explicaciones teóricas físicas incompletas y costos de tiempo significativos. Aunque se han realizado intentos de utilizar el aprendizaje automático para el procesamiento de materiales con láser, la falta de datos suficientes sigue siendo un obstáculo importante. En los marcos de aprendizaje automático guiados por modelos-físicos-, los parámetros de mecanismos intermedios generados por modelos físicos, como la densidad plasmática máxima y la duración del plasma, se agregan como dimensiones adicionales a los vectores del conjunto de datos originales, combinados con algoritmos genéticos para optimizar los parámetros de proceso multi-dimensionales. La inclusión de información del mecanismo físico aumenta las dimensiones de los datos, enriquece el conjunto de datos de entrenamiento y reduce la cantidad de datos necesarios. Este enfoque mejora la precisión del modelo con tamaños de muestra pequeños, lo que permite una predicción precisa de la profundidad de LIPMM. La introducción de información física guía el proceso de optimización con implicaciones físicas más razonables, a saber, mayor densidad de plasma máxima, mayor duración del plasma, mayor energía de pulso único-y superposición de puntos relativamente menor, optimizando así el rendimiento de LIPMM.

03 Resumen

La integración de la inteligencia artificial y el micro-nanoprocesamiento láser está experimentando una profunda revolución, y su función evoluciona desde la optimización de procesos de un único-punto hasta la construcción de sistemas de "fabricación cognitiva" de extremo-a-de extremo. Actualmente, la vanguardia de este campo se centra en modelos-con base física, en particular la aplicación profunda de redes neuronales-con base en física. Este paradigma avanzado de aprendizaje automático ya no es simplemente un "imitador" basado en datos-sino un "comprensor" de las leyes físicas. Al incorporar ecuaciones físicas centrales, como la conducción de calor y la dinámica de fluidos, como limitaciones en el proceso de entrenamiento de las redes neuronales, los modelos aún pueden hacer predicciones precisas de acuerdo con principios físicos a pesar de los escasos datos experimentales. Esto no sólo resuelve la dependencia de los modelos tradicionales de aprendizaje automático en conjuntos de datos masivos etiquetados, sino que también otorga una capacidad de generalización de "inferencia de uno a muchos", haciendo que sus predicciones sean físicamente interpretables. Actualmente, los investigadores están construyendo entornos de formación "híbridos". En este entorno, el entorno de aprendizaje por refuerzo se basa en simulaciones físicas muy realistas para aprender estrategias de procesamiento fundamentales, que luego se ajustan y validan rápidamente-utilizando datos reales durante el procesamiento.

El aprendizaje automático transforma las complejas interacciones entre la luz y la materia en leyes físicas programables y optimizables, lo que impulsa a la industria manufacturera a lograr un cambio de paradigma de la "dependencia-de la experiencia" a la "autonomía cognitiva". Esta profunda integración nos está llevando más allá de los enfoques tradicionales de prueba-y-error hacia una nueva era de fabricación precisa impulsada tanto por datos como por conocimiento físico.